L’IA fait encore parler d’elle et cette fois c’est avec Florent Pagny, une figure emblématique de la chanson française, qui a récemment été victime d’une usurpation d’identité.

Mais cette fois, la méthode employée n’est pas ordinaire ! 🤔

Grâce à l’intelligence artificielle (IA), des fraudeurs ont réussi à imiter sa voix, son image, et même à créer des vidéos trompeuses. Cette situation soulève nouvellement une question cruciale : quelles sont les limites de l’IA, notamment en matière d’usurpation d’identité ?

L’usurpation d’identité de Florent Pagny : un cas inquiétant

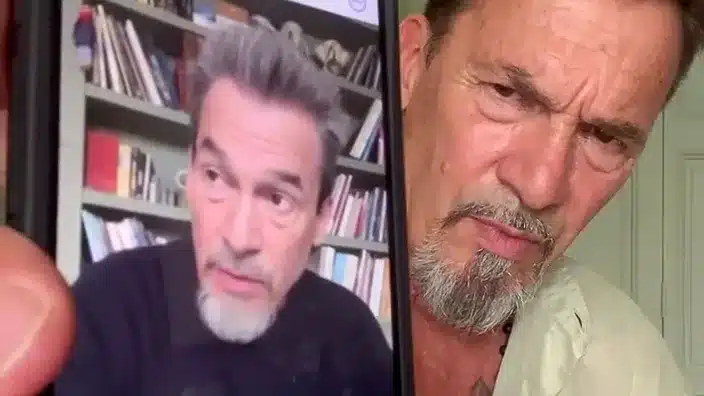

Florent Pagny, qui n’est pas un adepte des réseaux sociaux et qui se montre de moins en moins depuis l’annonce de sa maladie, a pris la parole sur les réseaux sociaux pour exprimer son inquiétude après avoir découvert que son image et sa voix avaient été usurpées par des technologies basées sur l’IA. À l’ère du numérique, cette situation montre à quel point les nouvelles technologies, en particulier l’intelligence artificielle, peuvent être utilisées de manière malveillante.

Et ça fait peur ! 😰

Les fraudeurs ont exploité des outils comme le deepfake pour créer des vidéos où l’on croit voir et entendre Florent Pagny alors qu’il ne s’agit en réalité que d’une imitation numérique. Ces vidéos sont si réalistes qu’il devient presque impossible de distinguer le vrai du faux.

Et malheureusement, ce n’est pas un cas isolé, puisque ce n’est pas le premier artiste ou personnalité publique à se faire usurper son identité. Avant lui, Barack Obama, Tom Cruise, Kanye West, Scarlett Johansson et j’en passe.

Les limites de l’IA : jusqu’où peut-elle aller ?

1. La manipulation des voix

La capacité de l’intelligence artificielle à imiter des voix humaines avec précision est stupéfiante. Grâce à des algorithmes sophistiqués et à de grandes quantités de données, l’IA peut analyser la voix d’une personne et la reproduire presque à la perfection. Cependant, cette capacité pose des problèmes majeurs en matière de sécurité et de protection des données personnelles.

Dans le cas de Florent Pagny, sa voix a été synthétisée pour créer des enregistrements qui semblaient authentiques. Et bien que certaines technologies puissent détecter des voix synthétiques, elles ne sont pas infaillibles, et les fraudeurs trouvent constamment de nouvelles manières de contourner ces défenses.

2. L’utilisation abusive des images et vidéos

Outre la voix, les deepfakes utilisent également l’image pour usurper l’identité de quelqu’un. L’IA peut manipuler une vidéo pour faire en sorte qu’une personne semble dire ou faire quelque chose qu’elle n’a jamais dit ou fait. Cela représente une menace non seulement pour les célébrités, mais aussi pour les individus ordinaires.

Par exemple, il devient de plus en plus facile de créer des vidéos compromettantes d’une personne qui n’a jamais participé à un tel événement. D’ailleurs, cela est récemment arrivé à une artiste caribéenne qu’on aime bien, j’ai nommé : Shenseea ! Des photos d’elle en maillot de bain ont été reprises pour la faire paraître nue.

Cela peut avoir des conséquences graves pour la réputation et la vie privée de la personne concernée.

3. Le vol d’identité numérique

Le cas de Florent Pagny est emblématique d’un problème plus large : le vol d’identité numérique. À mesure que les technologies d’intelligence artificielle progressent, il devient de plus en plus facile pour des individus malveillants de voler des informations personnelles et de les utiliser pour usurper l’identité de quelqu’un.

Les limites de l’IA dans ce domaine sont floues. Si la technologie peut accomplir des merveilles lorsqu’elle est utilisée à bon escient, elle peut aussi causer des dégâts considérables lorsqu’elle est mal employée. L’IA ne connaît pas de limites morales, ce qui signifie qu’elle peut être utilisée aussi bien pour le bien que pour le mal, en fonction des intentions de ceux qui la manipulent.

Comment se protéger contre l’usurpation d’identité via l’IA ?

Face à tout cela, comment se protéger contre l’usurpation d’identité via l’ IA ? Malheureusement, il n’y a pas encore de réponse exacte à cette question. L’utilisation de l’IA pour créer des contenus trompeurs soulève de nombreuses questions éthiques non encore résolues.

En effet, il n’y a pas encore une vraie réglementation ou régulations strictes autours des technologies de l’IA.

Aujourd’hui, la meilleure façon de s’en protéger c’est de s’y intéresser. S’informer et s’éduquer à l’utilisation et aux risques liés à l’intelligence artificielle et aux deepfakes.

Heureusement, certaines entreprises travaillent sur des technologies capables de détecter les deepfakes et autres formes d’usurpation d’identité numérique. Cependant, ces technologies sont encore en développement et ne sont pas toujours accessibles au grand public.

Les outils de détection, bien qu’efficaces dans certains cas, ne sont pas infaillibles. Les créateurs de deepfakes deviennent de plus en plus habiles, et il s’agit d’une course contre la montre pour les développeurs de solutions de sécurité.

Ce qu’il faut retenir

Le cas de Florent Pagny illustre à quel point l’intelligence artificielle peut être à double tranchant. Si elle offre des opportunités incroyables dans de nombreux domaines, elle peut aussi être utilisée à des fins malveillantes, comme l’usurpation d’identité. Les limites de l’IA sont encore floues, et il est essentiel de mettre en place des mesures pour encadrer son utilisation.

Les régulations, l’éducation du public et le développement de technologies de détection sont autant de solutions qui peuvent aider à freiner l’impact des deepfakes et autres techniques d’usurpation. Évidemment la bataille ne fait que commencer. En attendant, il est crucial de rester vigilant face à ces nouvelles menaces.